-

AutorPostagens

-

-

Microsoft, Github,

e OpenAI AI

processo de direitos autorais:

O que isto significa

para propriedade de negros /

start-up de tecnologia africana

ups?:

O litígio em curso envolvendo Microsoft, GitHub, e OpenAI ressalta a importância de entender as implicações legais, de propriedade intelectual e contratuais nesta era de inovação em IA. Ele destaca considerações proeminentes sobre a lei de direitos autorais, a NÓS instituído Lei de Direitos Autorais do Milênio Digital [DMCA] conformidade e a aplicação de materiais licenciados/não licenciados em IA, redefinindo como start-ups e organizações de tecnologia abordam o desenvolvimento de software.

Suas implicações são de longo alcance, particularmente no domínio da Código aberto, e no setor de tecnologia de forma mais ampla.

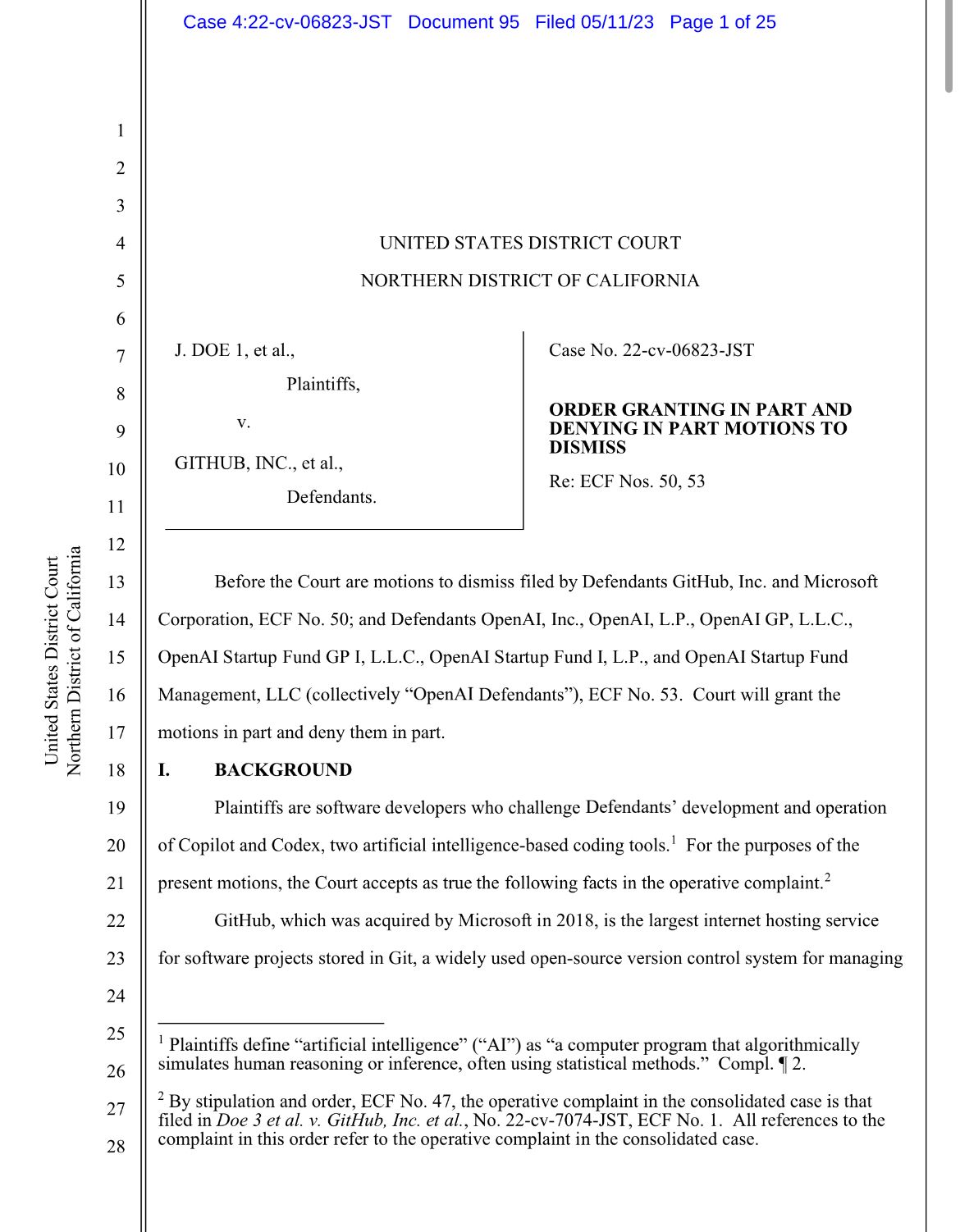

Sobre sexta-feira, 11 de maio de 2023, os Réus em um caso [Microsoft, GitHub, et.al] defenderam com sucesso a maioria das reivindicações apresentadas contra eles.

O processo alega que Microsoft, GitHub e OpenAI violaram o uso adequado e ético de materiais de código aberto licenciados e a violação do DMCA na criação de ferramentas de IA Copilot e Codex – particularmente a reprodução, lucro e distribuição de código protegido por direitos autorais sem levar em consideração os associados avisos de direitos autorais ou termos de licença, violação dos termos da comunidade de código aberto, deturpação da fonte e extensão do código usado, facilitando assim a violação e fraude de direitos autorais.

Conforme observado na resposta apresentada pela Microsoft e OpenAI, eles argumentam; as reclamações “falha em dois defeitos intrínsecos: a falta de lesão e a falta de uma reivindicação viável”, alegando “um saco de reivindicações que falham em alegar violações de direitos legais cognoscíveis”. Tudo isso levanta importantes questões legais e éticas.

Ao chegar ao julgamento, o Tribunal considerou que as alegações de contravenção/violação de seções específicas do DMCA, incluindo representação falsa e designação de origem, interferência ilícita, enriquecimento sem causa, fraude, concorrência desleal e negligência foram negadas - embora com licença e aberto a emendas.

O raciocínio por trás disso foi que o tribunal considerou que os requerentes não conseguiram provar danos de fato suficientes para suas reivindicações de danos à privacidade e aos direitos de propriedade, mas, no entanto, reconheceram sua legitimidade para buscar uma medida cautelar, o que pode impedir os réus [Microsoft, GitHub e OpenAI] de tomar medidas específicas – para proteger ativos ou interesses comerciais de terceiros.

O que isso significa para start-ups tecnológicas africanas/pertencentes a negros?:

O actual orientação do escritório de direitos autorais dos EUA afirma explicitamente que, a menos que haja envolvimento humano suficiente, as criações de IA não estão sujeitas à proteção de direitos autorais.

Outros países, ou uniões monetárias, como o UE se inscreveram no Tratado de Direitos Autorais da OMPI de 1996 através de Diretiva CIS 2001, incluindo o Reino Unido. No Reino Unido, a legislação primária que rege a lei de direitos autorais é a Lei de direitos autorais, designs e patentes de 1988 (CDPA), que podem ser exigíveis internacionalmente.

Com outras empresas e Getty Images, procurando tomar medidas legais para ferramentas de arte de IA criadas por Estabilidade AI, Midjourney, e DeviantArt por violar as leis de direitos autorais ao extrair ilegalmente imagens e trabalhos de artistas da Internet, pode haver questões contratuais e de propriedade intelectual significativas a serem consideradas se você estiver usando IA para criar ou desenvolver código. Se você é uma startup ou empresa apoiada por capital de risco, essas são considerações importantes a serem observadas, e as empresas precisam garantir que estejam protegidas ou que seu investimento em tecnologia/software seja sólido, atendendo a todos os VC, due diligence técnica/de investimento.

Da mesma forma, pode ser importante considerar se você está inserindo código de propriedade de seu empregador em ChatGPT, GPT4, Google Bard AI, etc, pois isso pode violar as políticas e/ou acordos de propriedade intelectual ou confidencialidade de sua empresa.

Três perguntas importantes que todo advogado/advogado de patentes ou direitos autorais que trabalha com IA e desenvolvimento de software pode fazer, incluem: qual componente específico do código do software foi desenvolvido usando código aberto, quais licenças específicas de código aberto foram utilizadas e qual código foi gerado de forma autônoma etc… e esta lista não é exaustiva.

A questão importante aqui é que, com o uso de código gerado por IA, a proveniência e a originalidade precisam ser determináveis no sistema e no design dos produtos.

À medida que monitoramos o andamento deste caso, assim como de outros, ele nos leva a uma reavaliação crucial das estratégias tecnológicas diante do cenário jurídico relacionado à IA em rápida evolução.

Quais medidas você está tomando em sua organização para garantir que sua estratégia de gerenciamento de tecnologia/riscos acompanhe o cenário legal desafiador em torno da IA?

Quais medidas legais ou técnicas você está considerando para mitigar possíveis problemas de propriedade intelectual e direitos autorais?

SUCULTURA.

-

@SUCULTURA Muito obrigado por alertar a comunidade de tecnologia sobre este caso.

Tem amplas implicações. A lição a ser aprendida aqui é que o uso ético da IA, promovendo a confiança nas comunidades de código aberto e protegendo os direitos das partes interessadas são todos componentes de uma estratégia robusta de risco de IA.

Parece que as empresas devem procurar aconselhamento jurídico com antecedência.

j.

-

-

AutorPostagens

Você precisa estar logado para responder a este tópico.